音楽とヒューマン・コンピュータ・インタラクション研究の動向 (2020)

この記事は Medium に掲載した記事抜粋・修正したものです。

音楽とヒューマン・コンピュータ・インタラクション研究

ソフトウェアや I/O デバイス, インターフェースに始まり可視化 ・可聴化 ・マテリアルなど, ヒトと情報技術との相互作用全般について研究する分野であるヒューマン・コンピュータ・インタラクション(HCI)の中でも音楽について扱う領域 Music and HCI があります。

Open Univesity Music Computing Lab の Simon Holland の著書 Music and HCI の中で, その研究領域について

"Music Interaction encompasses the design, refinement, evaluation, analysis and use of interactive systems that involve computer technology for any kind of musical activity"

とあり, 研究の対象とモチベーションアプローチはかなり多岐にわたることがわかります。

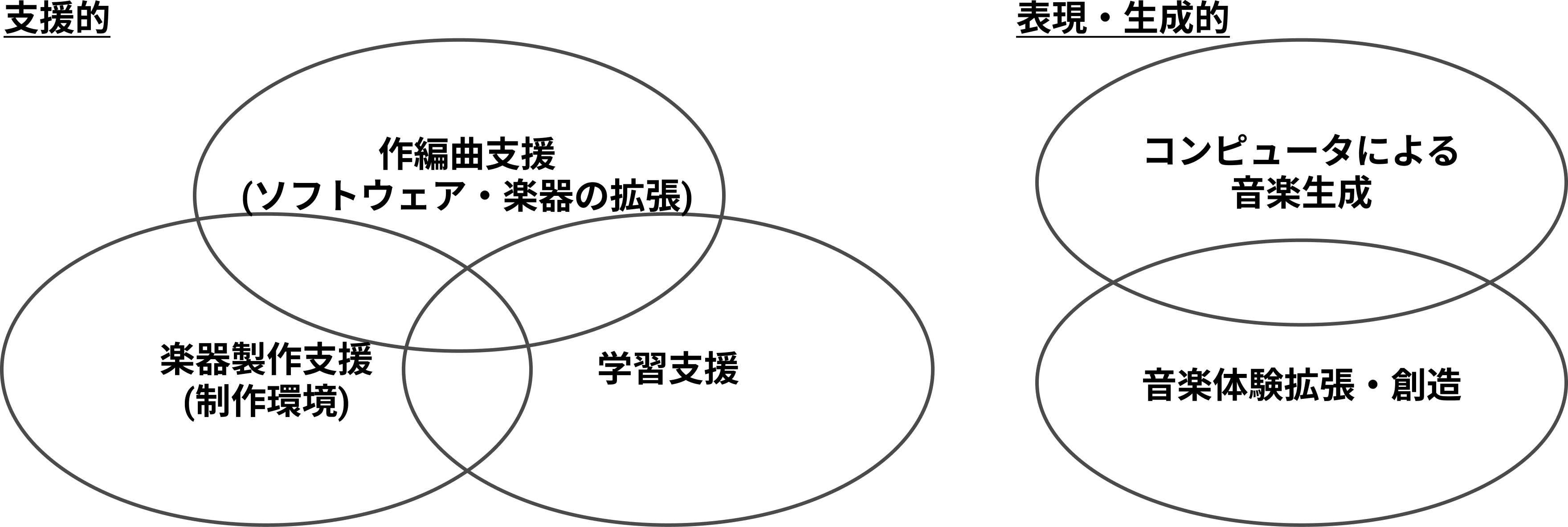

また, 竹川らの研究報告[1]には, 作編曲支援, 楽器製作支援, 学習支援の3つの側面から音楽とのインタラクション研究がまとめられています。 それらに加え, 近年の人工知能技術の発展や AR(拡張現実), VR(仮想現実)環境の普及と発展に伴い, 新たな領域での作品やエクスペリエンス・デザイン(XD)や音楽の生成への応用研究が増えているのも事実です。

そこで, 今回は整理と事例収集のため音楽とヒューマン・コンピュータ・インタラクション研究事例におけるアプローチを以下の5つに分類しました。

Ⅰ.楽器製作支援(音楽制作環境)

新しい音楽インターフェースの国際学会である NIME(New Interfaces for Musical Expression) や, 情報処理学会音楽情報科学研究会(SIGMUS) などで多くの新しいデジタル楽器(DMI — Digital Musical Instrument)が発表されています。

それら電子楽器を製作するためのプラットフォームとして, IRCAM が 90 年代から開発を行っている OpenMusic をはじめ, Max や PureData, TidalCycles, FAUST, StanfordのChuck, 九州大学 (現 藝大AMC) の松浦さんが開発している Mimium など, 作曲のためのプログラミング環境やライブラリが数多く開発されています。 ハードウェアによる楽器のプロトタイピングには, Arduino や Gainer (NTT ICC ページ) に加え, esp32 や Raspberry Pi, Sony (SSS) のSpresense (参考: DSP用lib) などが用いられることが多いです。

それらハードウェア・ソフトウェアの通信には, MIDI や Open Sound Control(OSC)が用いられており, Libmapper などの通信用ライブラリも開発されています。RMCP(Remote Music Control Protocol)や, 一昨年に38年ぶりにアップデートされた MIDI2.0 のように, コンピュータ音楽のための新たな通信プロトコルに関する研究開発も存在します。

Ⅱ.作編曲支援(ソフトウェアによる支援)

コンピュータを用いて数理や外部の因子によって作曲を行う環境を提供することで, 人間の作曲編曲を支援するシステムの開発や研究が進んでいます。

東大嵯峨山研の Orpheus(2006)は, ユーザーが入力した歌詞に合わせ自動で作曲が可能な自動作曲システムであり, 入力言語の形態素解析の後, 韻律推定が行われ音符に割り当て, 典型的なリズムパターンを「標準リズム」として定義し割り当てていくことで生成を行います。

MIT Media Lab の Opera of the Future による Hyperscore(2012)は, 縦軸に音高, 横軸に時間が割り当てられているユーザーインターフェースに, ペンツールで描画することで作曲ができ, ペンの色によって音色を変えられるというものです。かつてのクセナキスによるコンピュータ UPIC のもつインターフェースと類似した, 作曲における直感的なインタラクションを実現しています。

Sony CSL が2014年以降研究開発を進めている FlowMachines: AI Assisted Music は, 音楽においてクリエイターの創造性を拡張することを目指す研究開発兼社会実装プロジェクトとして多数のプロダクトを生み出している。

Ⅲ.学習支援

今日ではビデオゲームによるピアノ・ギター演奏(Rocksmith など)も普及し, 電子楽器に備え付けのチュートリアル機能(V-Drums などにはトレーニング機能が付属)なども多く存在しますが, カーネギーメロン大学で開発されたピアノの練習を支援するシステム Piano Tutor(1990)[4] は, 人工知能技術による演奏学習の支援のさきがけ的研究です。演奏追従認識による自動譜面めくり・ビデオや音声による模範演奏の提示・練習者の演奏データの解析と改善点の指示などが可能となっており, 驚きです。

近年のものでは, 運指認識技術を活用し直接鍵盤上へ情報を投影して練習支援を行うシステム(2011)[3] や, 記録したドラム演奏における打叩時刻のずれと打叩強度の情報からその演奏の特徴に関する計 31 通りの特徴パラメータを抽出し, そこから演奏熟達度の推定値を算出してフィードバックを行うドラムの練習支援システム(2015)[4] などが発表されています。また, 東大矢谷研 (iis-lab) の研究 Strummer [5] は, コードラベルが付与された 727 曲分の楽曲データを利用し, 音響信号解析によってユーザが正しいコードを弾いたのかを認識してフィードバックを行うシステムで, 5人のギター初心者が計5時間ずつのギター練習を行った後に評価を実施しています。

Ⅳ.音楽の生成

初のコンピュータによる作曲(楽譜の生成)は 1957 年の ILLIAC による「弦楽四重奏のためのイリアック組曲」で, マルコフ連鎖と乱数生成に基づいて音高列を生成するモジュールと生成結果の判定を行うモジュールから成り立ち, 対位法と和声に基づいたルールでの判定を行っています。

コンピュータはより普及すると, アルゴリズミックコンポジションと呼ばれる, アルゴリズムや一定の手続きによる決定的・確率的な作曲手法に多く用いられていきました。

その後は, 統計モデル等によるメロディやリズムパターン, コード進行の生成を行う研究が増え, 近年ではニューラルネットワークによる音楽の生成手法も多く提案されています。MIDI の系列や五線譜等を生成する(シンボリックドメイン)手法と, 波形を直接生成する(オーディオドメイン)手法のアプローチが存在します。

Google Magenta からは既にプラグインとしてメロディの生成(MIDI)が可能なソフトウェア Magenta Studio がリリースされており, OpenAI の Jukebox などを始めとした, 生成された音楽を視聴できる Web サイトや Boomy のような作曲サービスも多数登場しています。

Ⅴ.音楽体験拡張・創造

音楽の演奏体験や視聴体験の多感覚化や新しい体験の創出を目指したインターフェースやプラットフォーム等の研究開発が進んでいます。

有名な新しい音楽インターフェースの例として挙げられるのは, ヤマハが1995年に発売した, センサーやスピーカーを組み込むウェアから構成された新しい楽器 Miburi です。演奏者の指・手首・肘・肩・足にセンサをつけることで演奏者の体の動きやステップに応じた演奏が可能となっており, 多くの演奏者を生みました。

また, 明和電機のオタマトーン(2009年)も近年ヒットした新しい音楽インターフェースの一つです。まるで人が歌っているかのような音を出すことのできる楽器であるオタマトーンには, プッシュ奏法やポルタメント奏法など様々な奏法もあり, 多くのユーザーが存在します。

一方で, 既存の楽器を拡張するアプローチをとる研究もあります。元の楽器の演奏感・音楽観を損なわずに演奏体験を向上させるシステムとして Cyber 尺八(1997)が挙げられます。尺八本来が持つ楽器としての特質を減少させないことと奏者に可能な限り違和感を感じさせないことを考えてデザインされています。

元の楽器との出音の差異がダイナミックな研究の一例としては, バルブの変位や楽器の位置などのジェスチャーデータをキャプチャし, リアルタイムなサウンドエフェクトやヴィジュアルアートのコントロールが可能なトランペットである MIGSI (Minimally Invasive Gesture Sensing Interface)(2018)が挙げられます。MIGSI の特徴的な点は, 単なる実験的なプロトタイピングではなくリッチなユーザーインターフェースと楽曲も製作されているところです。

MIGSI のインターフェース

他には, MIR(音楽情報検索)を応用した音楽体験の拡張として, 音楽推薦システムの研究が挙げられます。協調フィルタリングによる推薦をはじめとし, 楽曲からの特徴量抽出(Bag-of-features 等)による類似楽曲推薦, ユーザーの状況を考慮した推薦(context-aware recommendation), 感性を表す言語表現から楽曲を検索する研究等があります。

また, インタラクティブパフォーマンスに音楽インターフェースを活用したものも多く存在します。その中でも古典的なものの一つとして, MIT Media Lab のパフォーマンス Brain Opera (1996) があります。様々な電子デバイスによる音楽装置を使って参加者が作曲し, それらの作った曲を組み合わせて 1 つの作品にするもので, Harmonic Driving joystick, Melody Easel, Sensor Chair, Rhythm Tree など様々な新しい楽器デバイスが開発されました。

また, VR による音楽体験は既にミュージックビデオ等のメディア作品に応用されています。

参考文献

[1] 音楽とヒューマン・コンピュータ・インタラクション 竹川佳成(公立はこだて未来大学)— 526 情報処理 Vol.57 №6 June 2016

[2] Dannenberg, Roger & Sanchez, Marta & Joseph, Annabelle & Capell, Peter & Joseph, Robert & Saul, Ronald. (1990). A computer‐based multi‐media tutor for beginning piano students. Journal of New Music Research. 19. 155–173.

[3] 佳成竹川, 努寺田, 昌彦塚本. 運指認識技術を活用したピアノ演奏学習支援システムの構築. 情報処理学会論文誌, Vol. 52, №2, pp. 917–927, feb 2011.

[4] 希子安井, and 雅展三浦. 2015. "ドラム基礎演奏の練習支援システム(システム論文特集号)." 日本音響学会誌 71 (11): 601–4.

[5] S Ariga, M Goto, and K Yatani. Strummer: An interactive guitar chord practice system. In 2017 IEEE International Conference on Multimedia and Expo (ICME), pp. 1057–1062, July 2017.

[6] 吉井和佳, 2. 音楽と統計的記号処理, 映像情報メディア学会誌, 2017, 71 巻, 7 号, p. 457–461.