音楽人工知能をどう扱うか — 深層音楽生成モデルとインターフェース研究 (2021)

この記事は Medium に掲載した記事の抜粋・修正 転載です。

はじめに

人工知能による楽曲生成・メロディ生成技術はかなり高度な結果を出力できるまで発展しており,昨年発表された OpenAI の JukeBox は,waveform ドメインでの Transformer ベースの巨大モデルであり,莫大な計算資源を用いて歌詞から波形を生成しています。かなりリアルです。

一方で MIDI 等を生成するシンボリックな生成手法もかなり高度な表現が可能になっており,深層学習を用いた歌詞のテキスト情報による条件付けによる歌詞に合ったメロディの生成や,複数のメロディをきれいに混ぜ合わせるなど,作曲活動を効果的に支援し得る手法がいくつも提案されています。

音楽(メロディ)生成人工知能の活用事例

いくつかの代表的なプロダクトの事例を紹介します。

MagentaStudio—MagentaTensorflow

Google Magenta はオープンソースの研究プロジェクトで,MelodyRNN や MusicVAE,GrooVAE,Music Transformer 等の深層学習モデルの開発とオープンソースツールの提供を行っており,Magenta Studio は Ableton Live のプラグインとして用いることが出来るツールです。

実際に Live の Max for Live デバイスとして取り入れることで,簡単に複数の MIDI クリップを生成し自身の制作環境に取り入れることができます。

OrbProducerSuite—ORBCOMPOSER

Orb Composer は人工知能による作曲支援ツールですが,ユーザーがコントロールできるパラメータが多くあることが特徴です。

メロディの特徴をコントロールする値として Complexity, Density があり,Bar Length, Octave, Syncopation, Human Touch, Polyphony などで長さやリズムなどをコントロールできます。コード進行の生成とビートの生成も同様のコントロールが可能です。

FlowMachines—AIassistedmusicproduction

人工知能による楽曲制作支援ツールと共に AI アシスト楽曲制作プロジェクトも展開する Sony CSL のプロジェクトですが,Flow Machines を用いて制作されたプロジェクトとして,Lo-Fi HipHop チャンネルが解説されています。

Flow Machines は作曲者の求めるスタイルに合わせたメロディー・コード・ベースを提案する機能が主であり,このプロジェクトでは提案されたそれらの要素をクリエイターがヒトのセンスで選び制作を進めています。

研究事例

上記のようにいくつかのツールがすでに世に出されていますが,NIME2020 の論文 A survey on the uptake of Music AI Software では,それらのツールはほとんど使われていないことが示されています。

各音楽 AI ツールパッケージの利用状況。緑は「使ったことがない」(論文中より引用)

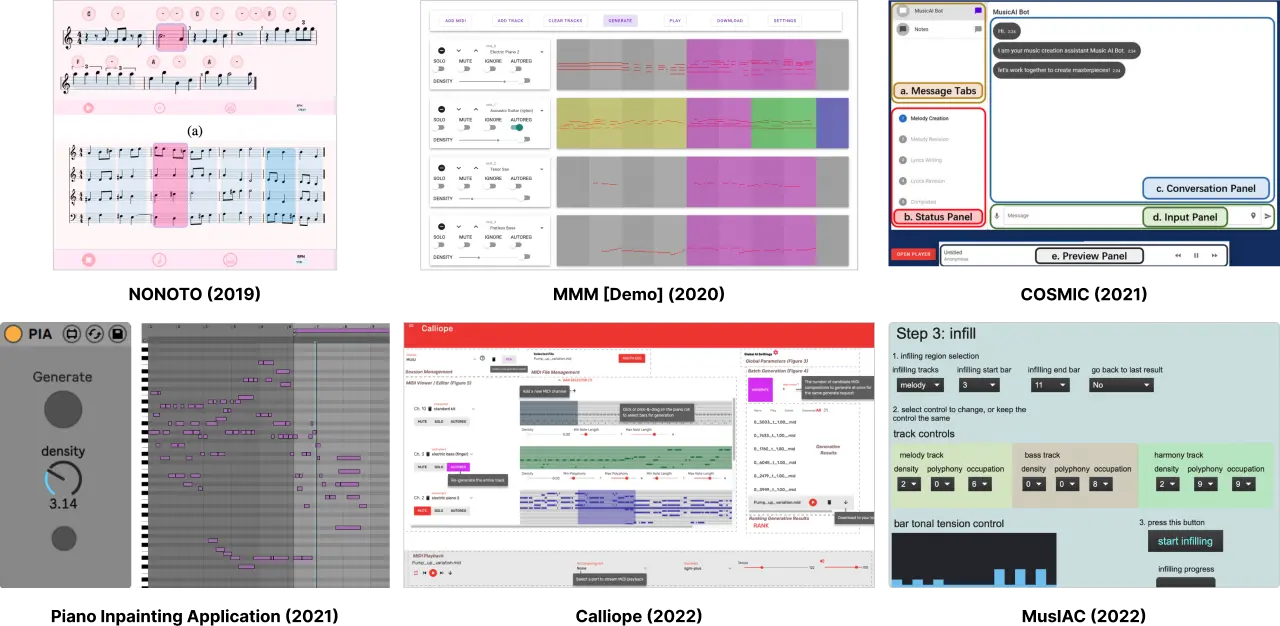

ここで,音楽人工知能とのインタラクションやそれらを扱うためのインターフェースについての主に2020年以降の研究動向について紹介します。

わかりやすいインターフェースとはどんなものか?

例えば作曲行為の初心者をサポートすることを考えた場合,上記で紹介したツールでのモデルのコントロールのためのパラメータを操作することは難しいようにも思えます。"初心者の支援のための AI の導入" というのは自然なモチベーションですが,その場合どのようなインターフェースが最適なのでしょうか。

CHI2020の人工知能との共創のためのツールについての論文 Novice-AI Music Co-Creation via AI-Steering Tools for Deep Generative Models では,人工知能によるツールが使われない理由の一つとして生成メロディの数が多すぎる点と,生成パターンが固定されずランダムに動きすぎる点が挙げられています。

本論文中で用いられているシステム Cococo では,変分オートエンコーダ (VAE) ベースの生成モデルを利用する上で,AI に生成させるパート (voice — ソプラノ・アルト・テノール・バス) を選択した上で,メジャー / マイナーのスライダーと conventional / surprising のスライダーで生成されるメロディのキャラクターをコントロールできます。また,生成させた部分を一時的に入れ替えたり,自身で作ったメロディを保管させる部分を選択する機能などを提供していることによって,多くの既存のインターフェースよりも高い評価を得ています。

またこのインターフェースは,CHI2021での人同士の共創における AI の役割についての研究 AI as Social Glue: Uncovering the Roles of Deep Generative AI during Social Music Composition でも用いられており,人工知能が入ることでヒトとヒトの共創 (co-creation) においてアイスブレーカー的な役割を果たすことが示されています。 音楽人工知能は複数の作曲者のメロディのアイデアの中間点・妥協点を生み出すことができ,同時に両方から明らかに乖離したものも生成可能であるため,共同作曲者が議論の状況を打開し,より広い選択肢を検討できるようにする効果があると言われています。

さらに,自然言語による対話を用いたインタラクションも提案されています。チャットボットを用いたインターフェースを取り入れることにより,音楽的な専門知識が無くてもメロディを口ずさむだけで作曲を行うことができるといった点がメリットとして挙げられます。

実際に IUI2020の Musical and Conversational Artificial Intelligence では,Google Dialogflow を用いてユーザーの作りたいメロディについてのやりとりを会話で行い,ユーザーがメロディを口ずさんでいる時は STFT を用いて解析をし,メロディ生成手法である Abstract Melodies (Machine Learning of Jazz Grammars) を用いた MIDI 生成を行っています。

また,NIME2021 の COSMIC: A Conversational Interface for Human-AI Music Co-Creation では "I want to create slow and sad song" などの会話文をクエリに,メロディと歌詞それぞれの生成を行うインターフェイスを提案します。

自然言語の表現獲得(エンコード)には BERT,音楽生成には BUTTER (ACL 2020 WS),会話応答には GPT-2 ベースのモデルである CoCon (ICLR 2021) といった具合に,どれも巨大でモダンな深層学習モデルを活用しています。

エンドユーザー=ミュージシャンへの最適化

Google Magenta の MusicVAE の潜在空間を個人に最適化する研究としては,潜在空間を再構成するより小さな VAE を学習する MidiME などがありますが,そのようなアプローチを応用した研究があります。

Generative Melody Composition with Human-in-the-Loop Bayesian Optimization では,単一のモデルであっても,ユーザー毎に異なる音楽的嗜好を考慮するためのインターフェースが提案されています。

ベイズ最適化により VAE の潜在空間を予測する上で効率的なサンプルを選択することで,少ない試行回数でもユーザーの好みに生成パターンを寄せる(= MusicVAE の潜在空間を再構成するより小さな VAE の入力を最適化する)ことを可能にしています。

また,その発展版とも言える IUI2021の Interactive Exploration-Exploitation Balancing for Generative Melody Composition では,このユーザーへの最適化手法を応用し,ミュージシャンがどのような作曲のフェーズにいるのかを考慮したインターフェースを搭載したものを提案しています。

創作を支援するツール (CST) に関するインタラクション研究では,創作行為には Ideation と Refinement の2つのフェーズがあるとされており,幅広くアイデアを色々試していくプロセスと,固まったアイデアをより洗練させていくプロセスという2つの段階であると解釈できます。

この研究で用意された Exploration — 探索 と Exploitation — 深堀り のスライダーは,調整することによってユーザーの好みに最適化される具合をコントロールできるため,探索的なフェーズではあまり自分が好まないようなメロディのパターンも生成させることができ,好みのメロディを深堀りするフェーズでは少しずつ変化する好みのメロディを選り好みすることができるということになります。

作品への応用と実践

それでは,現時点ではどのような作品への応用が見られるのかを見てみます。

VAE等の条件付け可能なモデルを用いた楽曲・作品

アメリカのバンド YACHT (Young Americans Challenging High Technology の略) の Claire Evans は '19 年の Google I/O でも公演をしていますが,MusicVAE を活用したアルバム Chain Tripping を発表しています。

音楽とのインタラクションのデザイン

楽曲制作を支援するという以外にも,人工知能によってメロディやビートを自動的に生成することで可能になることは多くあります。

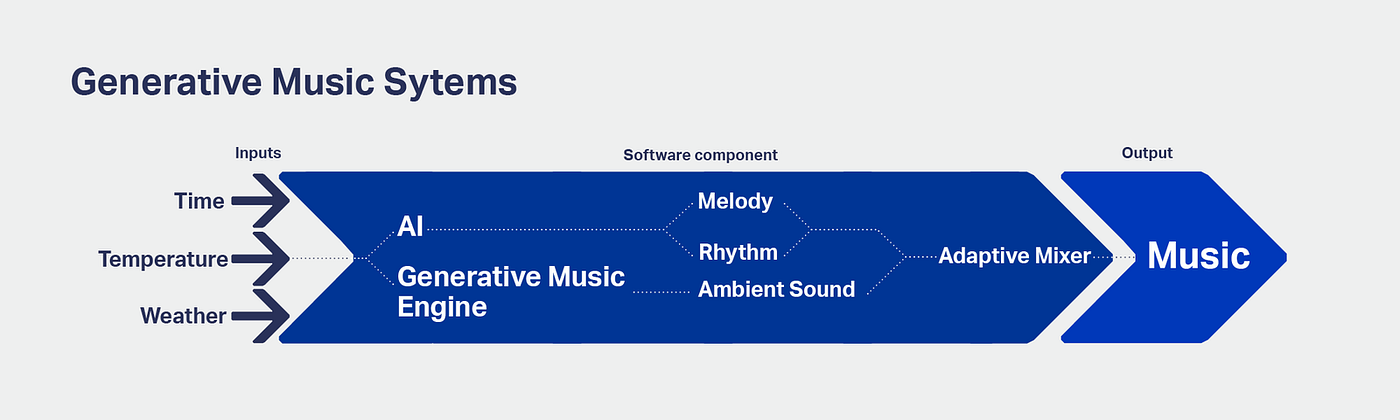

Qosmo が開発した,資生堂の銀座の旗艦店での BGM を自動生成する音楽生成システム では,人工知能によって生成されたメロディとリズムをルールベースでアルゴリズミックに生成される音とミックスし,取り入れる情報として時間帯・天気・気温をモニタリングすることで環境に合わせて動的に変化する BGM をつくりだしています。

Qosmo サイトより画像引用

Qosmo サイトより画像引用

私自身も,上で紹介したようなシンボリックなメロディ生成のモデルを用いた音楽体験のデザインの実践として,MR (Mixed Reality) 環境での空間とのインタラクションから連続的なメロディを生成し,体験者が今いる場所固有の BGM を自動生成するという試みを行っています。

MR 空間に浮かぶオブジェクトから発生する音を音楽に

MR 空間に浮かぶオブジェクトから発生する音を音楽に

オブジェクトから発生する音をメロディとみなし,学習済み MusicVAE モデルの encoder/decoder を用いたメロディの自動生成を連続的に行います。

おわりに

作曲支援のための音楽人工知能ツールが実際のプロダクションの場で多く活用されるためには,多くの課題があることも現実です。ユーザーであるミュージシャンが作曲活動・作曲の体験に求めることは何なのかを調査し,そのニーズにマッチした楽曲生成機能や人工知能とのインタラクションをデザインすることが重要であると感じます。

一方で音楽人工知能は作曲支援のためだけではなく,"リアルタイムで次々に生み出されていく新しい音楽を聴く・作り出す" など,新たな音楽との関わり方,流れている音楽とのインタラクションをデザインするためにも活用することができます。